DeepSeek、ChatGPT是怎么“懂你”的?

一、你有没有想过:它是怎么听懂你说话的?

你在DeepSeek或者ChatGPT对话框输入一句话:“帮我写一封关于***的感谢信。” 几秒钟后,一封语气真诚、逻辑清晰的信就生成了。

你可能惊讶:它真的听懂了我说的每个字吗?

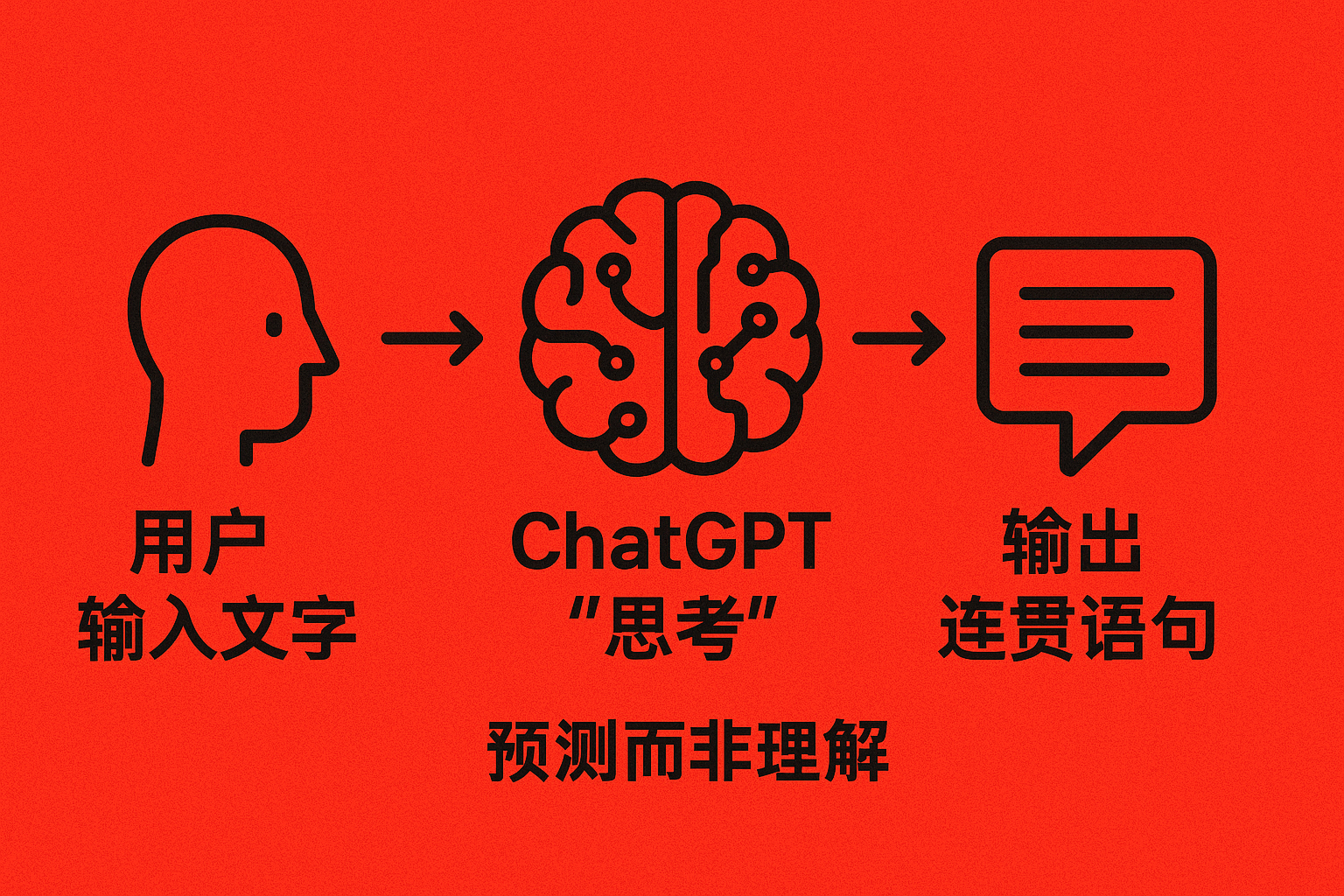

答案是:它其实并没有“理解”你——它是在“预测”你想说什么。

二、DeepSeek、ChatGPT的大脑:一个“超级语言预测器”

DeepSeek、ChatGPT的核心不是“思考”,而是预测语言。

你可以把它想象成一个读遍全世界图书馆的超级语言大师。

它经过数以万亿计的文字训练,学会了语言之间的规律:

哪些词经常一起出现?

哪种句式听起来更自然?

哪种语气更像在安慰、道歉或写论文?

于是,当你输入一句话时,它的“脑中”就会想:

“根据我看过的几亿句话,接下来最可能出现的词是哪个?”

它会一步步预测“下一个最合理的词”,再预测下一个,直到完成整段话。

举个生活例子:

当你看到“祝你生日——”,你脑中是不是自然会想“快乐”?

这正是ChatGPT在做的事——只不过它是把这种预测做到极致。

三、它是怎么学会这些的?——来自人类的“喂养”

DeepSeek、ChatGPT并不是天生聪明,它是“被训练出来的”。

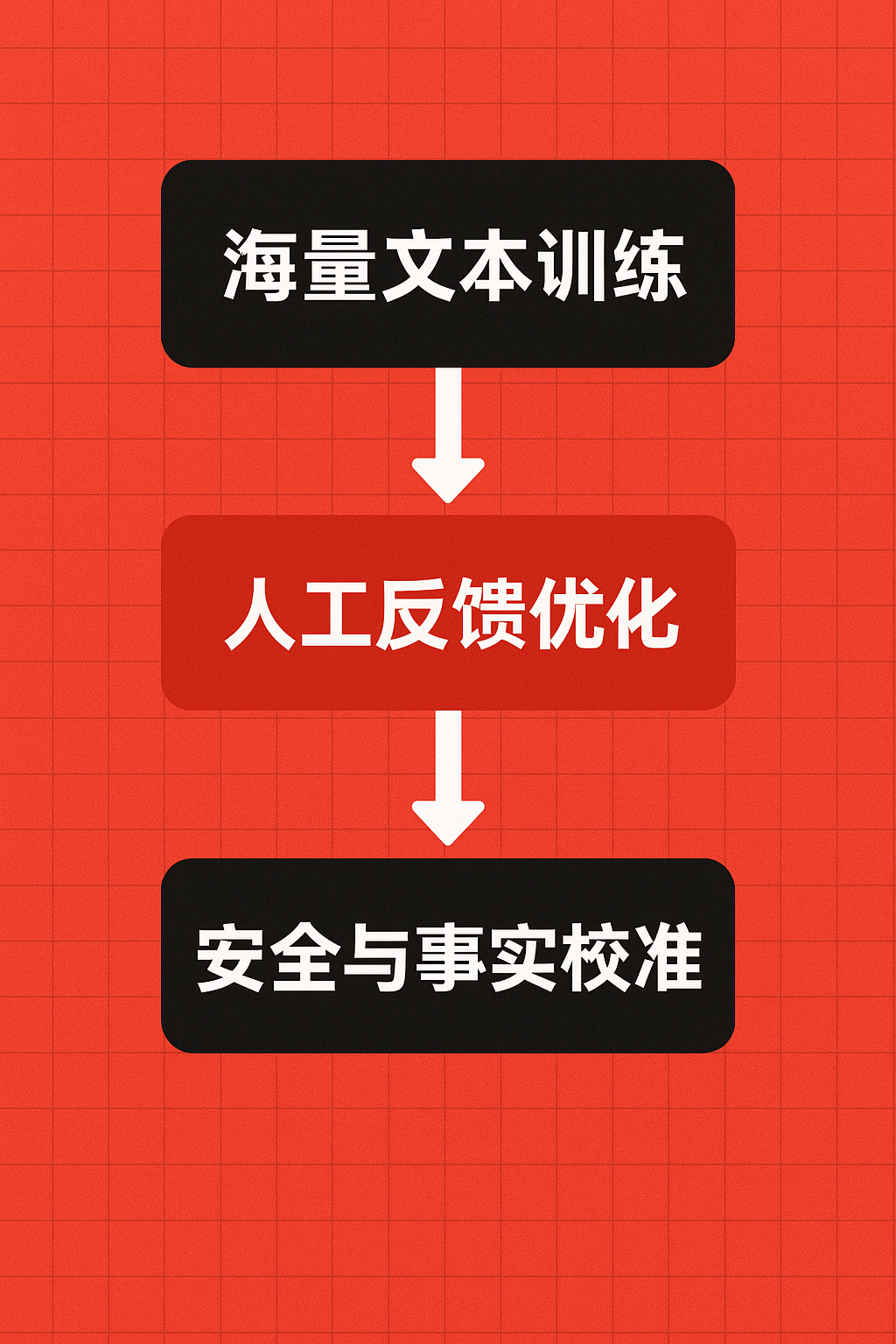

训练过程分三步

✅ 第一步:读遍人类世界的文本

DeepSeek、ChatGPT阅读了无数网站、书籍、新闻、代码、社交媒体内容。

它学会了语言规律,也学会了模仿不同的表达风格。

就像一个学生,把全球的“语料图书馆”全背下来了。

✅ 第二步:人类教它“好”与“不好”

模型输出的内容并非一开始就完美。

训练师会让它多次回答问题,然后人工挑选更好的答案。

系统根据这些“人类喜好”来调整算法。

比如:

你说“写一封关于***的感谢信”,

它可能生成三封不同版本,

人类标注员选择最自然、最真诚的那一封,

模型就学会了“这种语气更受欢迎”。

这一步叫 “人类反馈强化学习”(RLHF)。听起来高深,其实就是“人教AI写得更像人”。

✅ 第三步:不断微调与安全过滤

在DeepSeek、ChatGPT公开使用前,会对它进行了多轮“安全训练”:

过滤虚假、有害信息;

限制它对敏感问题的回答;

加入事实检查和提示功能。

这让它不仅能“说话像人”,还能“守规矩做人”。

四、为什么它有时会“胡编乱造”?

如果你用DeepSeek或者ChatGPT一段时间,你一定发现过它的一个怪毛病:

说话非常自信,但偶尔一本正经地胡说八道。

比如:

它能写出看似真实的新闻,但查无此事;

它能引用一篇论文,却根本不存在;

它能编造一个公司,却让你误以为是真的。

这并不是它“欺骗”你,而是它“太会编了”。

记住前面那句话:它不是在理解,而是在预测。

当它找不到正确答案时,会用最“像人”的方式凑出一个“听起来合理”的句子。

所以,它并不知道真假,只在乎“语言是否自然”。

这就像一个聊天很溜的朋友,不懂就瞎猜,还信心十足。

五、那它到底“懂”还是“不懂?

要回答这个问题,我们得先区分两个层次的“懂”:

层次 | 人类的“懂” | DeepSeek、ChatGPT的“懂” |

理解意义 | 理解情感、上下文、意图 | 统计语言规律 |

目的驱动 | 知道“为什么要说这句话” | 只知道“这句话之后最可能是什么” |

所以ChatGPT的“懂”,是统计上的懂,不是心理上的懂。

它懂“怎么说”,但不懂“为什么说”。

它理解“语言模式”,但不理解“人类情感”。

换句话说:

ChatGPT会模仿你的语气,却不会真的“感同身受”。

这也是为什么它能生成上万种文案,却写不出真正“感动自己”的一篇。

六、它的边界:有多强,也有多弱

DeepSeek、ChatGPT可以在文字领域表现得惊人,但仍有明显边界:

1️知识截止时间

它的“记忆”停留在训练数据的时间点(例如GPT-4是2023年左右)。

所以它对最近发生的事、最新的研究并不了解。(说明:现在商业化大预言模型,可以直接利用搜索引擎,搜索相关内容再次组织语言后进行输出)

2️缺乏事实核查机制

它不会主动上网验证信息。

当它不知道时,也不会说“我不知道”,而是“猜”一个答案。

3️无逻辑推理能力

虽然看起来能“讲道理”,但它不能像人那样真正思考因果关系。

它只能模仿逻辑,而不是真的推理。

4️依赖输入质量

你问得模糊,它答得更模糊;

你问得清晰,它才能精准回应。

所以,ChatGPT不是魔法,而是工具。

学会如何提问非常关键,这才是使用它的真正秘诀。

七、小结:AI的“懂”是人类智慧的镜像

ChatGPT像一面镜子,它映射的不是世界,而是人类写下的语言集合。

它让我们看到语言的力量,也提醒我们保持思考。

它不理解世界,却能帮你表达世界。

它不拥有知识,却能帮你整理知识。

它不具备创造力,却能放大你的创造力。

AI的本质不是取代,而是放大。

只要你学会使用它,它就能成为你的“智慧倍增器”。

手机扫描并关注微信公众号 AI上手实验室  获取全部AI从0到1的指导手册。

获取全部AI从0到1的指导手册。